Turing-Test

Philosophie

© 2016

- 2026

Basiswissen|

Was will der Test entscheiden?|

Turings imitation game mit Menschen|

Turings imitation game mit Maschinen|

Captchas als Zwischenform des Turing-Tests|

ChatGTP als turing-fähige Künstliche Intelligenz|

Was ist die philosophische Bedeutung?|

Was ist die soziologische Bedeutung?|

Persönliche Anmerkung|

Fußnoten

Basiswissen

Der englische Computer-Pionier Alan Turing schlug im Jahr 1950 vor, dass man nicht fragen sollte, ob Computer denken können, sondern lediglich, ob sie einen Intelligenztest bestehen können oder nicht. Dieser pragmatische Ansatz ist hier kurz vorgestellt.

Was will der Test entscheiden?

Turing beginnt seinen Gedankengang mit dem Vorschlag, dass man überlegen solle, ob Maschinen denken können. Doch er weist direkt darauf hin, dass die Wort Maschine und Denken schwer zu definieren seien. Um das Problem der Definition zu umgehen, schlägt er einen Test vor, das „imitation game“, in dem eine Maschine einen Menschen täuschen soll. Als Maschinen lässt er nur digital arbeitende elektronische Computer zu, etwa um künstlich hergestellte biologische Menschen auszuschließen.

Turings imitation game mit Menschen

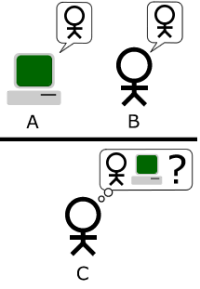

Das imitation game wird zunächst von drei echten Menschen gespielt: einem Mann (A), einer Frau (B) und einem Frager (interrogator), den Turing C nennt. C sitzt räumlich getrennt von A und B, kann sie also weder hören noch sehen oder sonstwie sinnlich wahrnehmen. Die Aufgabe von C ist es, alleine durch ausgetauschte Texte in Schreibmaschinenschrift A und B in Dialoge zu verstricken, die ihm am Ende sicher sagen, wer von den beiden der Mann und wer die Frau ist. Dabei ist es die Aufgabe des Mannes A, den Frager C zu täuschen. Der Mann muss also versuchen, dass C ihn irrtümlicherweise für eine Frau hält. Die Frau B hingegen darf C in jeder Weise helfen.

Turings imitation game mit Maschinen

Turing schlägt dann vor, dass der Mann A in dem imitation game durch eine Maschine ersetzt wird. Man fragt dann, ob der Frager C sich genauso oft falsch entscheidet wie bei dem Spiel mit den zwei echten Menschen. Diese Frage ersetzt dann, so Turing, die ursprüngliche Frage, ob Maschinen denken können (Can machines think?).

Captchas als Zwischenform des Turing-Tests

Um das Jahr 2020: unterweges im Internet musste man als auf Bildern einer Straßenkreuzung alle Bildelementemit Zebrastreifen oder Ampeln anklicken. Damit sollte man sich gegenüber einer Webseite als Mensch authentifizieren. Das englische Wort Captcha heißt ausgeschrieben: Completely Automated Public Turing test to tell Computers and Humans Apart. Der Sinn war, dass kleine Dialoge oder Tastenaktionen sicherstellen, dass keine Schadsoftware Dinge vollzieht, die nur ein Mensch tun sollte. Der zunehmende Schwierigkeitsgrad der Tests legt den Schluss nahe, das Schadprogrammen immer besser menschliches Verhalten simulieren können.

ChatGTP als turing-fähige Künstliche Intelligenz

Ende 2022 wurde der Plauderroboter (Chatbot) ChatGPT öffentlich zugänglich gemacht. Erstmals produzierte eine künstliche Intelligenz lange, in sich logisch aufgebaute Texte die ohne grammatische oder stilistische Fehler in vielen Sprachen verfügbar waren. In Israel wurde dann eine Art Turing-Test mit ChatGPT durchgeführt. Etwa 1,5 Millionen Spieler konnten online für zwei Minuten chatten. Manchmal war der Gesprächspartner ein Mensch, manchmal ein ChatGPT-bot. In nur 60 Prozent der Fälle konnten die Menschen den Chatbot korrekt erkennen. Damit, so argumentiert ein Fachartikel, wären die Menschen kaum besser gewesen als der Zufall. ChatGPT habe damit eine Art inoffiziellen Turing-Test bestanden [4]. Für einige Beispiele von ChatGPTs Fähigkeiten siehe den Artikel 👉 ChatGPT

Was ist die philosophische Bedeutung?

Sollte es Maschinen gelingen, menschliche Dialogfähigkeiten so weit zu simulieren, dass sie statistisch nicht mehr signifikant (Hypothesentest) von echten Menschen unterschieden werden können, stellen sich zwei Fragen zum Bewusstsein: a) inwiefern ist Bewusstsein eine notwendige Bedingung für Intelligenz oder Leben, wenn Computerprogramme alle Effekte erfolgreich simulieren können? Und b) falls man a bejaht, muss man dann Maschinen ein Bewusstsein zugestehen? Lies mehr unter 👉 Bewusstsein

Was ist die soziologische Bedeutung?

In dem Maße, wie Computersysteme einen Turing-Test bestehen, können wir sie immer weniger von Computern unterscheiden. Damit werden Computersysteme immer mehr zu ökonomischen Konkurrenten von Menschen. Wenn ein Computer im statistischen Mittel genauso gute Steuertipps geben kann wie ein menschlicher Steuerberater und gleichzeitig sehr viel billiger ist, dann werden auf lange Sicht die entsprechenden menschlichen Berufe wegfallen. Der Philosoph Nick Bostrom (Universität Oxford) sieht die Möglichkeit, dass Menschen dadurch letztendlich aus allen Einnahmequellen verdrängt werden könnten. Zur Abwendung eines solchen Szenarios müsste man vor allem marktwirtschaftlich Situationen abstellen, durch die Menschen von künstlichen Systemen verdrängt werden. Dieser Gedanke führt zur Idee einer 👉 Bostrom-Bremse

Persönliche Anmerkung

Es ist bemerkenswert, dass es einerseits seit der Einführung von ChatGPT und ähnlichen künstlichen Intelligenzen tatsächlich Maschinenenintelligenzen gibt, die mit größter Wahrscheinlichkeit den Turing-Test bestehen würde, dass aber andererseits das in Medien kaum einen Widerhall findet. Während in den Jahrzehnten von 1950 bis 2020 solche Maschinen ein rein akademisches Spielzeug für Gedankenexperimente waren, sind sie in den 2020er Jahren fast schlagartig und ganz undramatisch in den Alltag eingesickert. Was mir hier fehlt ist eine "offizieller" Abschluss, ein dramatischer Abschluss dieses Kapitels der Philosophie, etwa in Form einer Bühnenshow (Turing-Challenge, Beat Alan oder ähnlich benannt) oder eines online Spiels zum selbst ausprobieren. Was mich immer wieder wundert ist, mit welcher biedermeierhaften Unaufgeregtheit die meisten Menschen den Einbruch des Utopischen oder auch des Dystopischen in den Alltag geschehen lassen.

Es ist bemerkenswert, dass es einerseits seit der Einführung von ChatGPT und ähnlichen künstlichen Intelligenzen tatsächlich Maschinenenintelligenzen gibt, die mit größter Wahrscheinlichkeit den Turing-Test bestehen würde, dass aber andererseits das in Medien kaum einen Widerhall findet. Während in den Jahrzehnten von 1950 bis 2020 solche Maschinen ein rein akademisches Spielzeug für Gedankenexperimente waren, sind sie in den 2020er Jahren fast schlagartig und ganz undramatisch in den Alltag eingesickert. Was mir hier fehlt ist eine "offizieller" Abschluss, ein dramatischer Abschluss dieses Kapitels der Philosophie, etwa in Form einer Bühnenshow (Turing-Challenge, Beat Alan oder ähnlich benannt) oder eines online Spiels zum selbst ausprobieren. Was mich immer wieder wundert ist, mit welcher biedermeierhaften Unaufgeregtheit die meisten Menschen den Einbruch des Utopischen oder auch des Dystopischen in den Alltag geschehen lassen.Fußnoten

- [1] Alan Turing: Computing Machinery and Intelligence. In: Mind. October 1950.

- [2] Gotthard Günther: Das Bewusstsein der Maschinen. Eine Metaphysik der Kybernetik. Dritte erweiterte Auflage. Agis, Krefeld, Baden-Baden 2002. ISBN 3-87007-009-9 (Erstausgabe: 1957).

- [3] Nick Bostrom: The Future of Human Evolution. First version: 2004. Published in Death and Anti-Death: Two Hundred Years After Kant, Fifty Years After Turing, ed. Charles Tandy (Ria University Press: Palo Alto, California. 2004: pp. 339-371.

- [4] Celeste Biever: ChatGPT broke the Turing test — the race is on for new ways to assess AI Large language models mimic human chatter, but scientists disagree on their ability to reason. In: Nature 619, 686-689 (2023). doi: https://doi.org/10.1038/d41586-023-02361-7.